Mais Sobre o Perceptron e Bias

13 de abril, 2026

Em

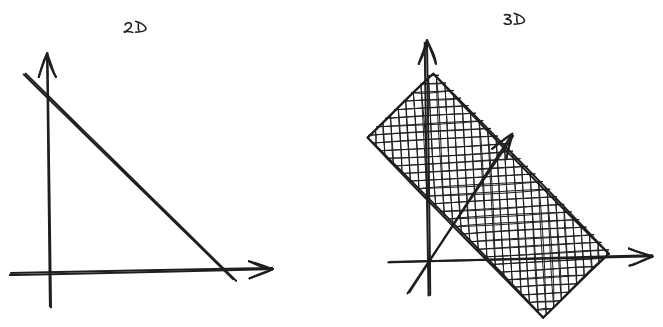

Deep Learning, Perceptron e a operação NANDvimos como funciona um Perceptron e o utilizamos para realizar a operação NAND. Escolheu-se esta operação como exemplo, pelo fato dela possuir um solução linear, ou seja, as instâncias podem ser corretamente classificadas através de um

hiperplano. Um hiperplano por definição é uma hipersuperfície plana, com uma dimensão a menos que o espaço em que está inserido, tendo-se que num espaço 2D consiste de uma reta, e num espaço 3D é um

plano.

Imagem 1. Hiperplano em um espaço 2D e 3D

Na Equação 1 exibe-se a expressão de um hiperplano num espaço com

dimensões.

Equação 1. Equação do Hiperplano em um espaço com N dimensões

A expressão está na forma de uma equação linear não degenerada, indicando que pelo menos um dos coeficientes não é nulo através do sinal de igualdade com a constante arbitrária

. A expressão também pode ser escrita como na Equação 2, em que ignoramos a troca de sinal de

já que isto não influencia em seu papel como valor arbitrário.

Equação 2. Rearranjo da equação do hiperplano

Observa-se que enquanto a equação do hiperplano representa uma solução linear, soluções não lineares tratam-se de equações do tipo

Polinomial,

Transcendente,

Base Radial, etc.

Na Equação 3 temos a fórmula utilizada pelo Perceptron.

Equação 3. Equação do Perceptron considerando N variáveis de entrada

Considerando que um espaço é dito ter

dimensões por comportar

variáveis, a equação do Perceptron, onde há pesos

para cada variável de entrada

e um valor arbitrário

(

bias

* peso), é corresponde à equação do hiperplano com coeficientes

para cada dimensão

e uma constante arbitrária

.

Podemos concluir então que no processo de treinamento de um Perceptron cria-se um hiperplano para solução do problema. No caso da operação NAND, dado que temos duas variáveis, operamos num espaço 2D para construção de uma reta que satisfaz os resultados esperados da operação, como ilustrado abaixo.

Imagem 2. Uma reta que soluciona a operação NAND

Visualização da Reta do Perceptron em um Espaço 2D

No gráfico da Imagem 2, representa-se as duas variáveis de entrada

e

nos eixos

e

, e o resultado do Perceptron através das cores azul (1) e vermelho (-1). São exibidas apenas as quatro combinações possíveis de valores booleanos, mas dados outros valores, como 1.5 e 0.5, o Perceptron também apresentaria um resultado, como mostra-se no Cálculo 1.

Cálculo 1. Resultado do Perceptron para diferentes entradas

Acima utilizamos os pesos obtidos após o treinamento do Perceptron para operação NAND. Estes pesos consequentemente formam uma reta semelhante a da Imagem 2, e uma propriedade desta reta é que quaisquer coordenadas ou combinação de valores de entrada que se situam acima dela, o Perceptron resulta em -1, e abaixo, resulta em 1. Observa-se que se escolhêssemos pesos aleatórios, poderiamos ter uma reta como na Imagem 3, que fornece apenas um resultado correto (

).

Imagem 3. Reta com pesos aleatórios para operação NAND

Para construção da reta produzida pelo Perceptron, formulamos o caso em que sua equação (Equação 3) resulta em 0, e fazemos um rearranjo colocando

em função de

, como mostra o Cálculo 2. O

bias

é desconsiderado na equação final por ter sempre valor 1.

Cálculo 2. Equação da reta do Perceptron

Igualamos a equação a zero para que a reta represente as coordenadas ou combinações de valores de entrada em que o produto escalar do Perceptron é zero, simbolizando também o limiar de decisão da função Sinal. Por fim, para projeção no plano 2D, colocamos a equação na forma

.

Para analisar o comportamento da reta em relação aos pesos e consequentemente a mudança dos resultados do Perceptron, no Gráfico 1 é possível interagir com os valores dos pesos e observar esta dinâmica. Observa-se o destaque dos resultados esperados

da operação NAND como referência.

+

output = 1

-

output = -1

+

y = 1

-

y = -1

Gráfico 1. Uso do Perceptron para solução da operação NAND

Limitação do Perceptron

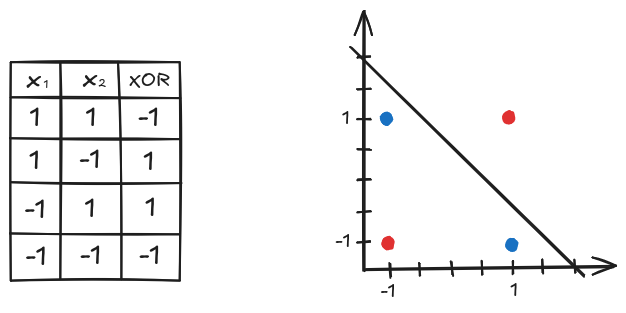

Visto que o Perceptron provém apenas soluções lineares através de um hiperplano, caso fosse aplicado a um problema não linear, não seria possível acertar todas instâncias como na operação NAND. Um exemplo é a operação lógica XOR, que se situa num espaço 2D e não possui uma solução através de uma reta. Na imagem abaixo apresenta-se uma tabela com os resultados da operação e uma tentativa de solução com o Perceptron.

Imagem 4. Tabela e tentativa de resolução da operação XOR com uma reta

Com isto, temos que para implementação do XOR é necessário trabalhar com mais de um Perceptron e consequentemente utilizar o algoritmo

Backpropagation

no processo de treinamento, se aproximando mais da complexidade de uma rede neural.

E o Bias?

Em

Deep Learning, Perceptron e a operação NAND, foi dito que o parâmetro

ou

, é semelhante ao parâmetro

na equação linear

, em que sua mudança possibilita a mobilidade da função no eixo

. Com o que vimos até agora, sabemos que isto é verdade para o Perceptron num espaço 2D, e é possível fazer esta análise no Gráfico 1 modificando o valor do peso

, considerando que o valor do

bias

é sempre 1.

Esta comparação tem o objetivo de introduzir a funcionalidade do parâmetro

de ampliar a capacidade da função de ativação do Perceptron. Imaginando que ao invés de utilizar zero como limiar na função Sinal, queiramos um valor generalizado

, teríamos uma função de ativação como na Equação 4.

Equação 4. Função de ativação com limiar generalizado

A partir disto, se desejamos manter o limiar zero, mas ainda incorporar este termo

, em

, teríamos

. Considerando que

é o produto escalar do Perceptron e

é um valor escalar arbitrário, o parâmetro

já realiza o papel de

, uma vez que

é inicializado de forma aleatória e é ajustado de forma positiva ou negativa durante o treinamento. A Equação 5 ilustra este processo.

Equação 5. Desenvolvimento da função de ativação com limiar generalizado

Assim, concluimos que o parâmetro

serve como um limiar generalizado para função de ativação do Perceptron.

Conclusão

Neste artigo analisamos a equação do Perceptron, entendemos sua limitação no espaço de dados e seu comportamento através de um gráfico interativo. Também retomamos qual a influência do

bias

e vimos sua relação com a função de ativação. Como próximo passo, podemos estudar conceitos como

Gradient Descent

e

Backpropagation

, e como funciona a comunicação entre camadas de uma rede neural.

Referências

- Ekman, M. Learning Deep Learning. Pearson Education, 2021.

- Hyperplane. Wikipedia, 2026. Disponível em: https://en.wikipedia.org/wiki/Hyperplane.

- Linear Equation. Wikipedia, 2026. Disponível em: https://en.wikipedia.org/wiki/Linear_equation.